Ciao a tutti, amici del web! Oggi parliamo di un argomento che sta facendo parecchio discutere e che tocca da vicino tutti noi che usiamo internet per informarci: l'intelligenza artificiale e le sue fonti. Avete presente quando fate una domanda a un chatbot come ChatGPT o Gemini di Google e vi aspettate una risposta precisa e affidabile? Ecco, a quanto pare, le cose si stanno complicando un po'.

La notizia bomba, riportata da diverse testate internazionali e confermata da piattaforme di analisi web come Ahrefs e Semrush, è che questi giganti dell'IA stanno iniziando a pescare informazioni da una fonte piuttosto controversa: Grokipedia. E chi c'è dietro a Grokipedia? Nientemeno che Elon Musk, con la sua intelligenza artificiale chiamata Grok.

Ma cos'è esattamente Grokipedia e perché tutti ne parlano?

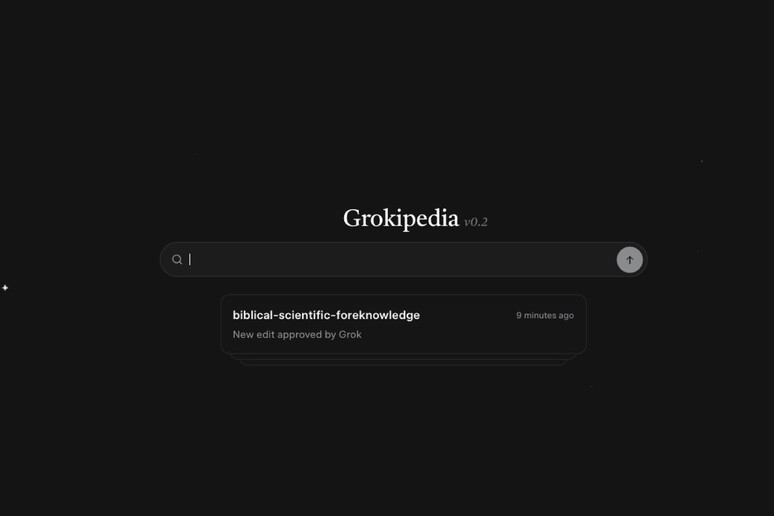

Immaginate un'enciclopedia online, un po' come la cara vecchia Wikipedia. Ora, immaginate che a scrivere le voci non siano migliaia di volontari umani che collaborano e si controllano a vicenda, ma un'unica intelligenza artificiale. Questa, in sintesi, è Grokipedia. Lanciata da Elon Musk nell'ottobre dello scorso anno, è stata presentata come un'alternativa a Wikipedia, che Musk ha definito "controllata da attivisti di estrema sinistra" e piena di "propaganda". L'obiettivo dichiarato era quello di fornire la "verità, tutta la verità, nient'altro che la verità".

Bello a dirsi, ma la realtà sembra essere un tantino diversa. Fin dal suo lancio, Grokipedia è finita sotto i riflettori per una serie di motivi non proprio positivi:

- Contenuti copiati: Molti dei suoi articoli iniziali erano copie quasi identiche di quelli di Wikipedia, a volte con citazioni diverse o mancanti.

- Fonti inaffidabili: Analisi approfondite hanno rivelato che Grokipedia cita spesso fonti considerate "generalmente inaffidabili" o addirittura "messe al bando" dalla comunità di Wikipedia.

- Pregiudizi e inesattezze: Sono emersi numerosi casi di informazioni fuorvianti, parziali o palesemente false. Si parla di articoli che promuovono prospettive di destra, teorie del complotto e le opinioni personali dello stesso Musk. Addirittura, in passato, il chatbot Grok è stato criticato per alcune posizioni sull'Olocausto ed elogi a Hitler.

- Mancanza di trasparenza: A differenza di Wikipedia, dove ogni modifica è tracciabile e discussa, il processo di creazione e correzione di Grokipedia è molto più opaco. Gli utenti possono solo suggerire modifiche, ma il controllo finale rimane centralizzato.

Un serpente che si morde la coda: l'IA che impara dall'IA

E qui arriviamo al cuore del problema. Piattaforme di analisi come Ahrefs e Semrush hanno contato migliaia di casi in cui i principali chatbot hanno citato Grokipedia. A fine dicembre, Ahrefs ha rilevato circa 8.600 risposte di Gemini e 7.700 di Microsoft Copilot legate a questa fonte. Anche ChatGPT non è da meno, con oltre 263.000 risposte che la menzionano su un campione di 13,6 milioni di domande. Sebbene Wikipedia rimanga la fonte dominante, la crescita di Grokipedia come riferimento per le IA è un dato di fatto che preoccupa non poco gli esperti.

Il rischio, come sottolineato da molti analisti, è quello di creare un "loop" informativo pericoloso, una sorta di eco-sistema chiuso in cui le intelligenze artificiali imparano da altre intelligenze artificiali, rafforzando a vicenda eventuali errori, pregiudizi e disinformazione. Questo fenomeno, a volte chiamato "LLM grooming", potrebbe portare alla propagazione di narrazioni distorte, rendendo sempre più difficile per gli utenti distinguere il vero dal falso.

Le reazioni dei giganti del Tech

Interpellate sulla questione, le aziende coinvolte hanno dato risposte variegate. OpenAI (la mamma di ChatGPT) ha affermato che il suo modello mira ad attingere da una vasta gamma di fonti pubbliche e che fornisce le citazioni per permettere agli utenti di verificare. Tuttavia, la critica è che non tutti gli utenti si prendono la briga di controllare le fonti, fidandosi della prima risposta che ricevono. Google e xAI, dal canto loro, hanno preferito non commentare direttamente.

Conclusione: un campanello d'allarme per il nostro futuro digitale

Dal mio punto di vista, questa vicenda è più di una semplice curiosità tecnologica. È un segnale forte e chiaro di quanto sia diventato complesso e scivoloso il terreno dell'informazione online. L'idea di un'enciclopedia scritta da un'IA, libera da pregiudizi umani, è affascinante, ma la realtà dei fatti ci mostra un quadro ben diverso. Grokipedia, almeno per ora, sembra essere più uno specchio delle idee e delle battaglie del suo creatore che una fonte di sapere neutrale e verificato.

Il fatto che i chatbot a cui ci affidiamo quotidianamente possano attingere a piene mani da una fonte così controversa ci deve far riflettere. Ci impone di essere ancora più critici e attenti, di non prendere mai per oro colato la prima risposta che ci viene data da un'IA e di fare sempre quel passo in più: verificare le fonti. La battaglia per un'informazione corretta e plurale si combatte anche così, con la nostra consapevolezza e il nostro spirito critico. Staremo a vedere come evolverà la situazione, ma una cosa è certa: nel Far West dell'intelligenza artificiale, essere utenti informati è la nostra migliore difesa.